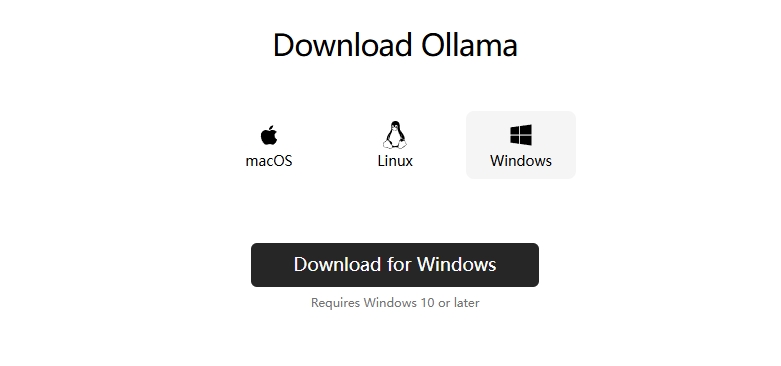

安装 Ollama,下载地址

拉取 qwen2.5-coder 模型

| |

拉取仓库代码

| |

安装依赖包,前提需要先安装 Node 环境

| |

修改项目的 .env.example 为 .env,并调整 OLLAMA_API_BASE_URL

| |

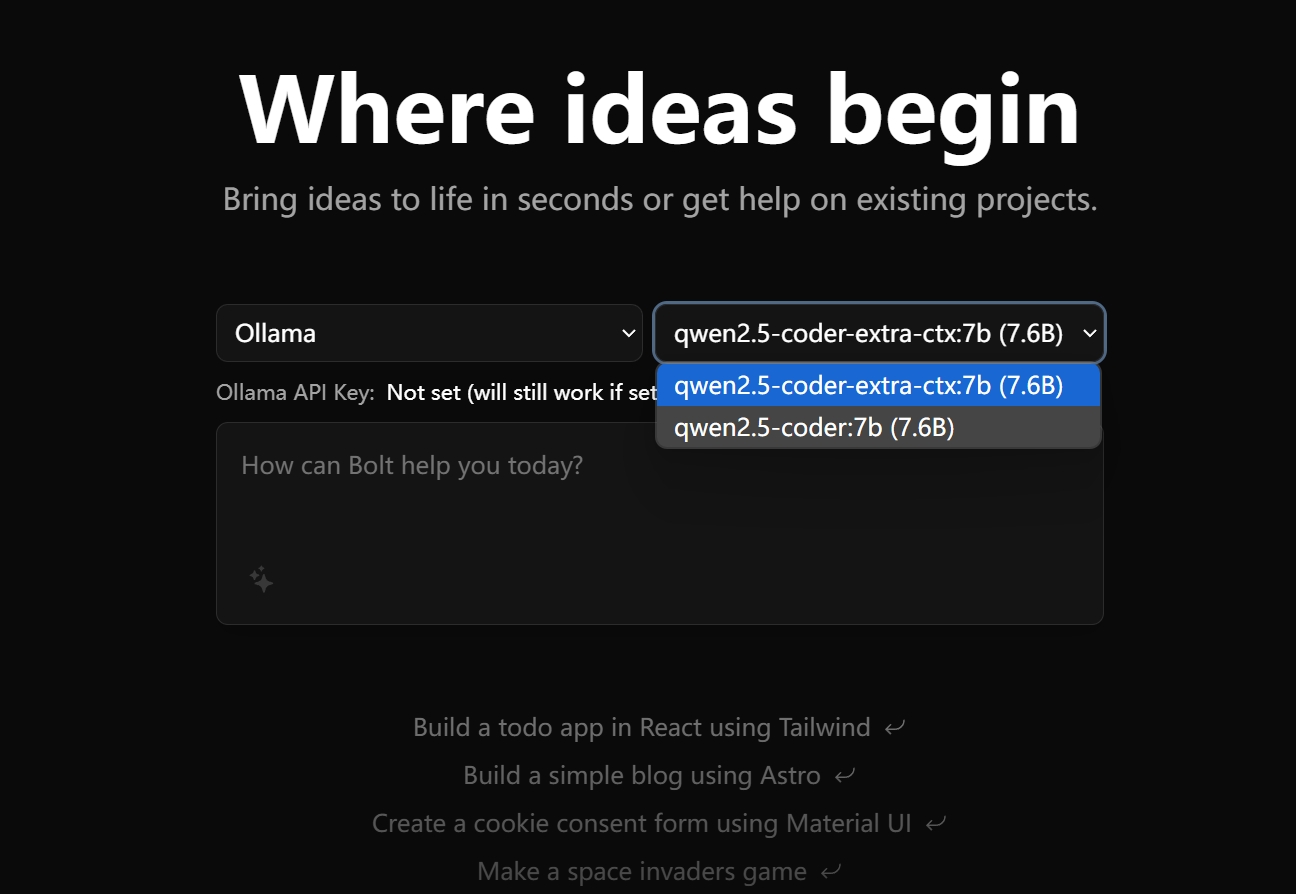

默认情况下,Ollama 模型的上下文窗口只有 2048 个标记。即使对于可以轻松处理更多内容的大型模型。这个窗口不够大,无法处理 Bolt.new/oTToDev 提示符,所以我们可以根据 qwen2.5-coder:7b 创建一个指定更大上下文窗口的模型

创建 Modelfile 文件,内容如下:

| |

在命令行中输入以下命令,例如新的模型名称为 qwen2.5-coder-extra-ctx:7b

| |

运行项目

| |

此时在界面中就能够看到 Ollama 模型的选项

然后测试一下,让它用 nextjs 框架写一个用户登录的界面

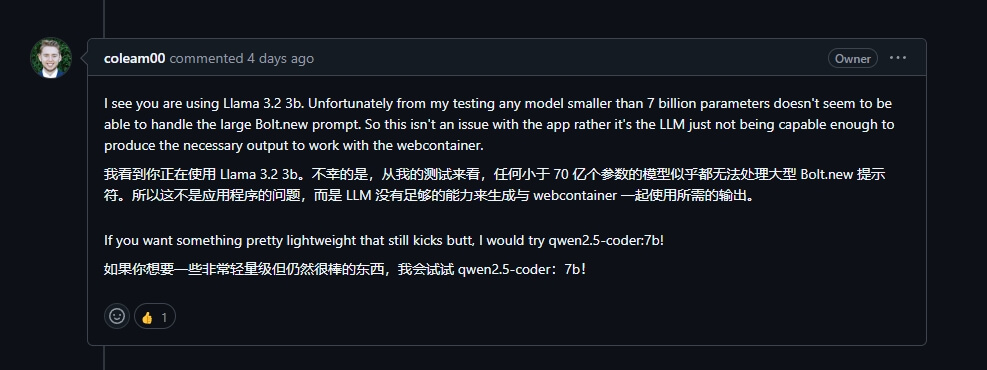

需要注意的是,所选的模型不能少于 7b 参数,否则可能会无法处理大型 Bolt.new 提示符,就不会自动生成代码和预览功能