Kimi K2.5 Agent Swarm 深度解析:开源项目 swarm‑ide 安装与使用教程

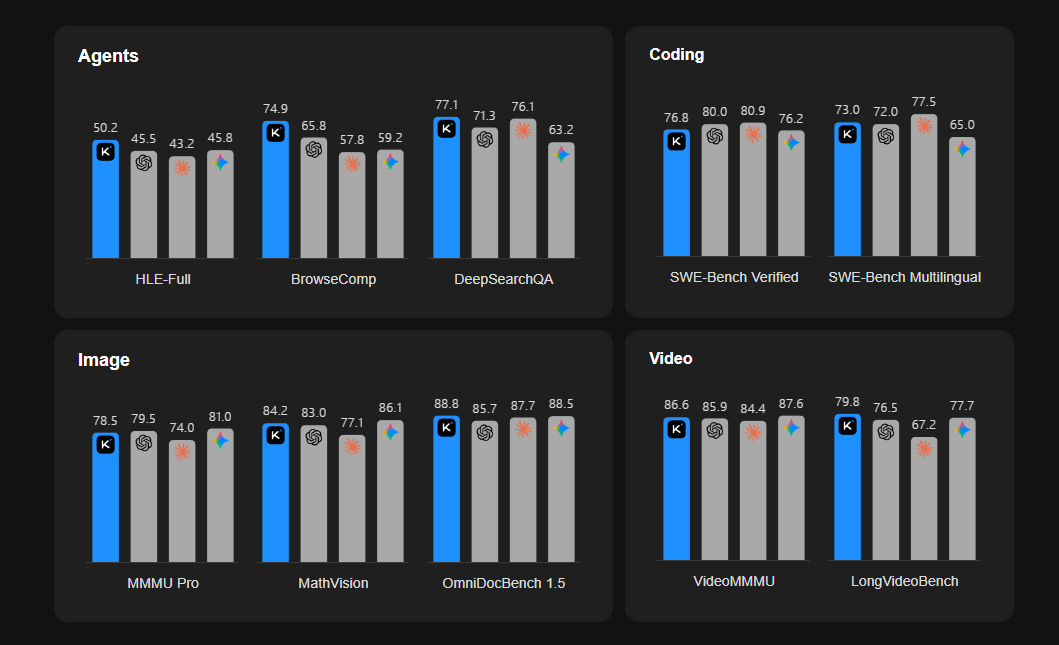

最近一段时间,大模型领域最受关注的更新之一,莫过于 Kimi K2.5 的发布。相比参数规模或榜单成绩,这一代模型真正引发讨论的,是它对 Agent 模式 的原生支持。模型不再只是“一个人在思考”,而是开始具备“组织多个智能体协作完成任务”的能力。

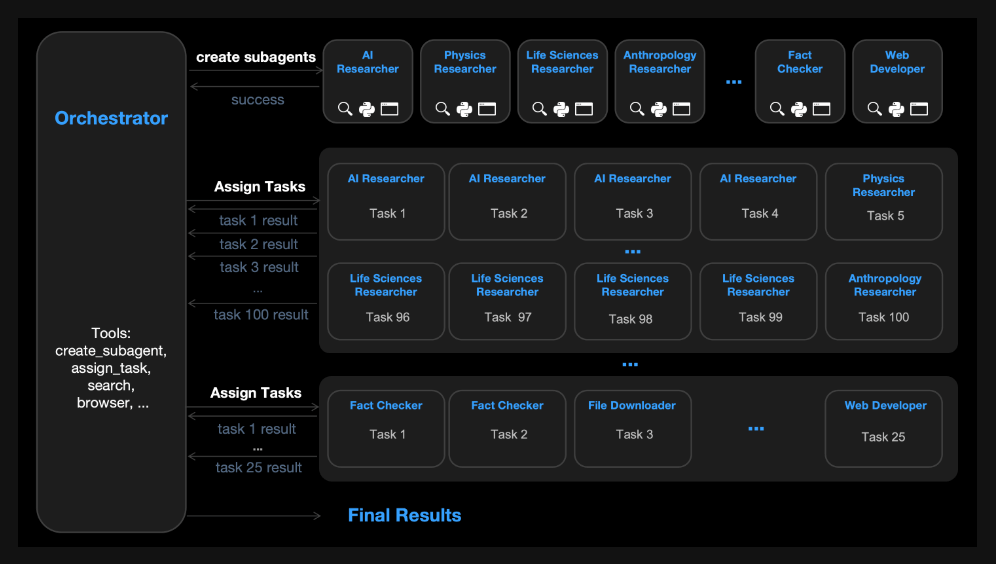

在 K2.5 中,模型可以根据任务复杂度,自动决定是否需要拆分任务,并创建多个子 Agent 并行工作。这种模式通常被称为 Agent Swarm(智能体集群):

- 一个 主 Agent 负责理解目标、拆解任务

- 多个 子 Agent 各自承担明确子任务

- 最终由主 Agent 汇总、校验并输出结果

这种方式非常接近真实团队的协作模式,而不是传统大模型那种“单线程长思考”。

swarm‑ide

无独有偶,最近发现一个有趣的开源项目 swarm‑ide,作者的介绍是 为 Agent Swarm 打造的 IDE ,支持 Kimi-2.5, GLM-4.7 等(即使不像 K2.5 那样经过强化学习的模型也能用)

只要通过简单的对话,就能够构建起自己的 Agent 体系,而且是通过 UI 看板的方式,全方面的可查看工作状态,而不再是一个“黑盒”

安装

首先克隆开源仓库到本地,前提需要先安装 Nodejs 环境

| |

然后切换到 backend 目录,进行依赖包的安装

| |

中间件

要启动这个项目,需要 pgsql 和 redis,如果你本地没有,则可以通过官方仓库的说明,使用 docker compose up -d 的方式加载。那么如果你已经有相关的中间件,则不需要执行,只要调整相关的配置即可,下面会介绍

配置

复制环境变量文件

| |

并调整相关的配置,其中 LLM_PROVIDER 为所使用的提供商,如果你使用下面的 OpenRouter 配置,则这里改为 openrouter

| |

其实感觉这里都是支持 openai 兼容的格式

启动

这里有个坑,可能作者也没有注意,就是在 package.json 文件中,是绑定了本地IP,如果你是局域网访问就不行了

| |

所以如果你是局域网访问,那么就将 127.0.0.1 改为 0.0.0.0

然后就可以启动项目,作者推荐使用 bun,但是我没有安装,我直接使用 npm

| |

初始化 db

作者这边说明中,需要访问网页前,先执行一个接口请求来初始化数据库,如果你是局域网,那么就调整对应的 IP 地址即可

| |

体验

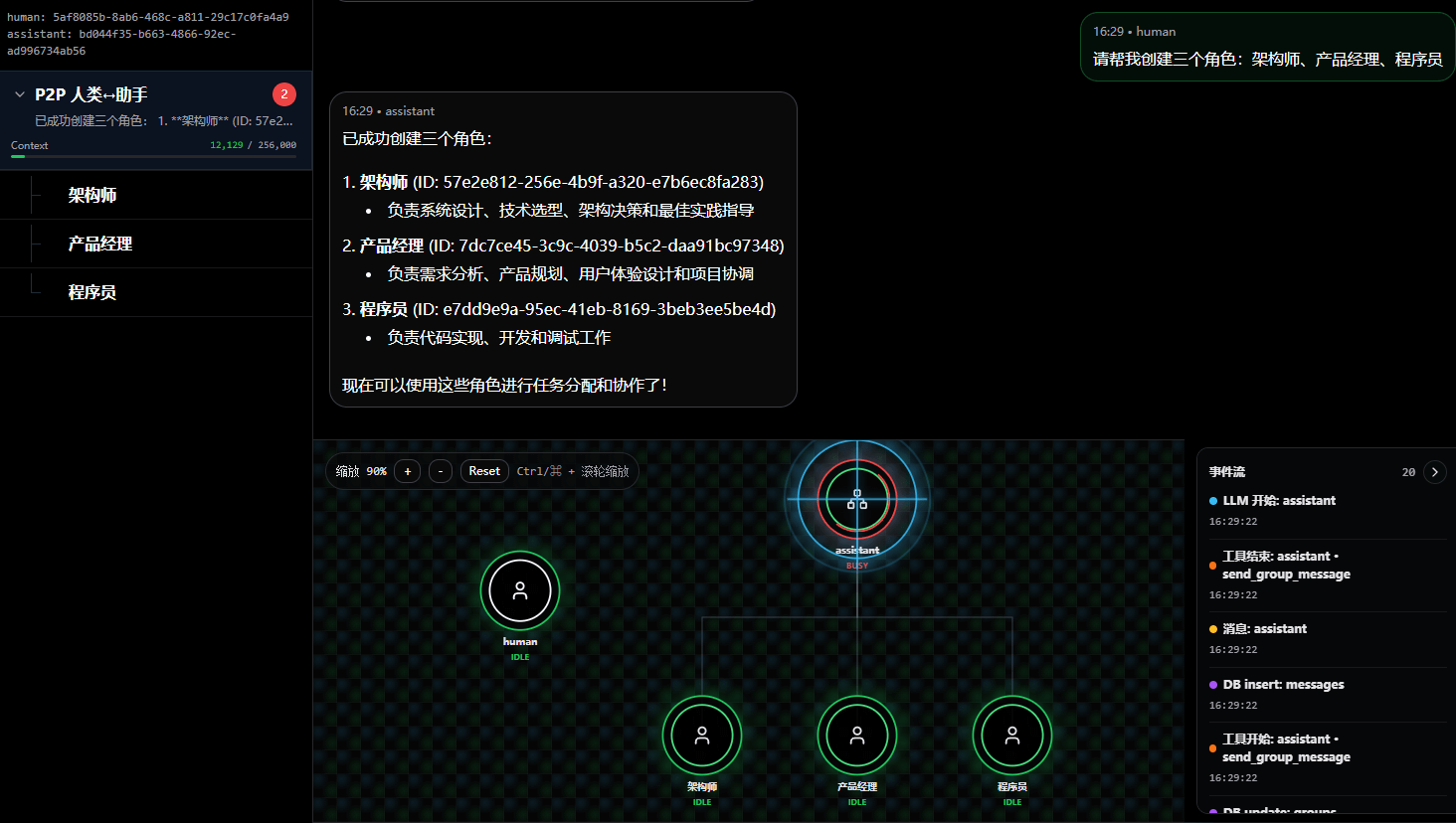

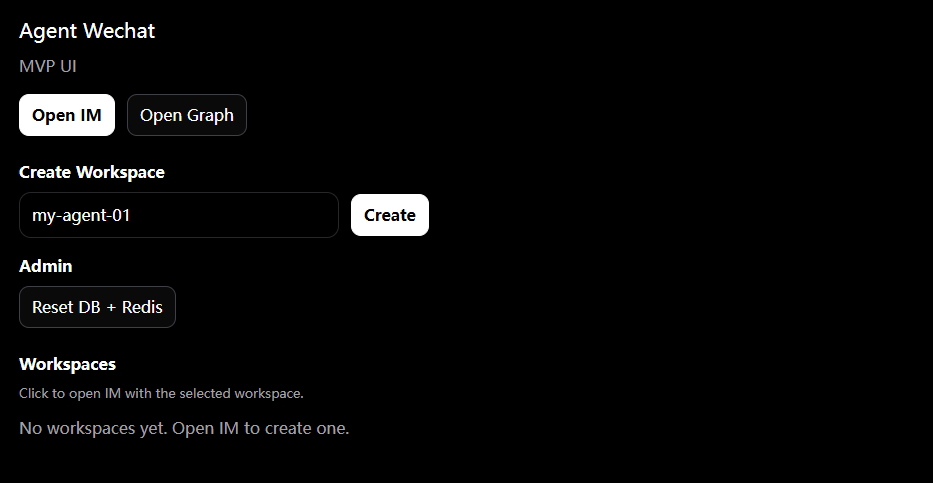

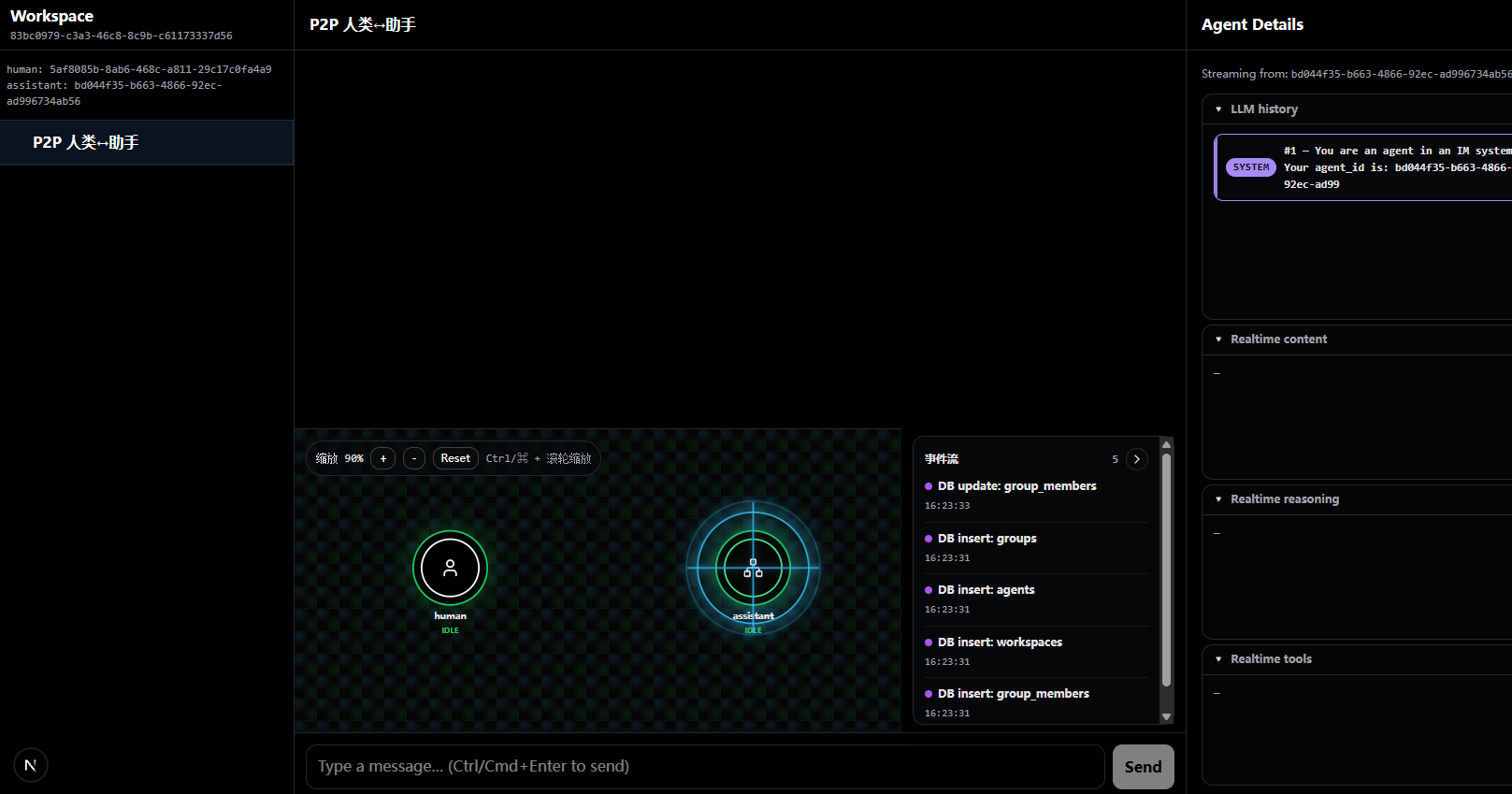

接下来就可以打开 3017 端口访问网页,进来的时候先要创建一个工作区,随便起个名字然后点击 Create

进来后就能够看到这个多区域的后台界面

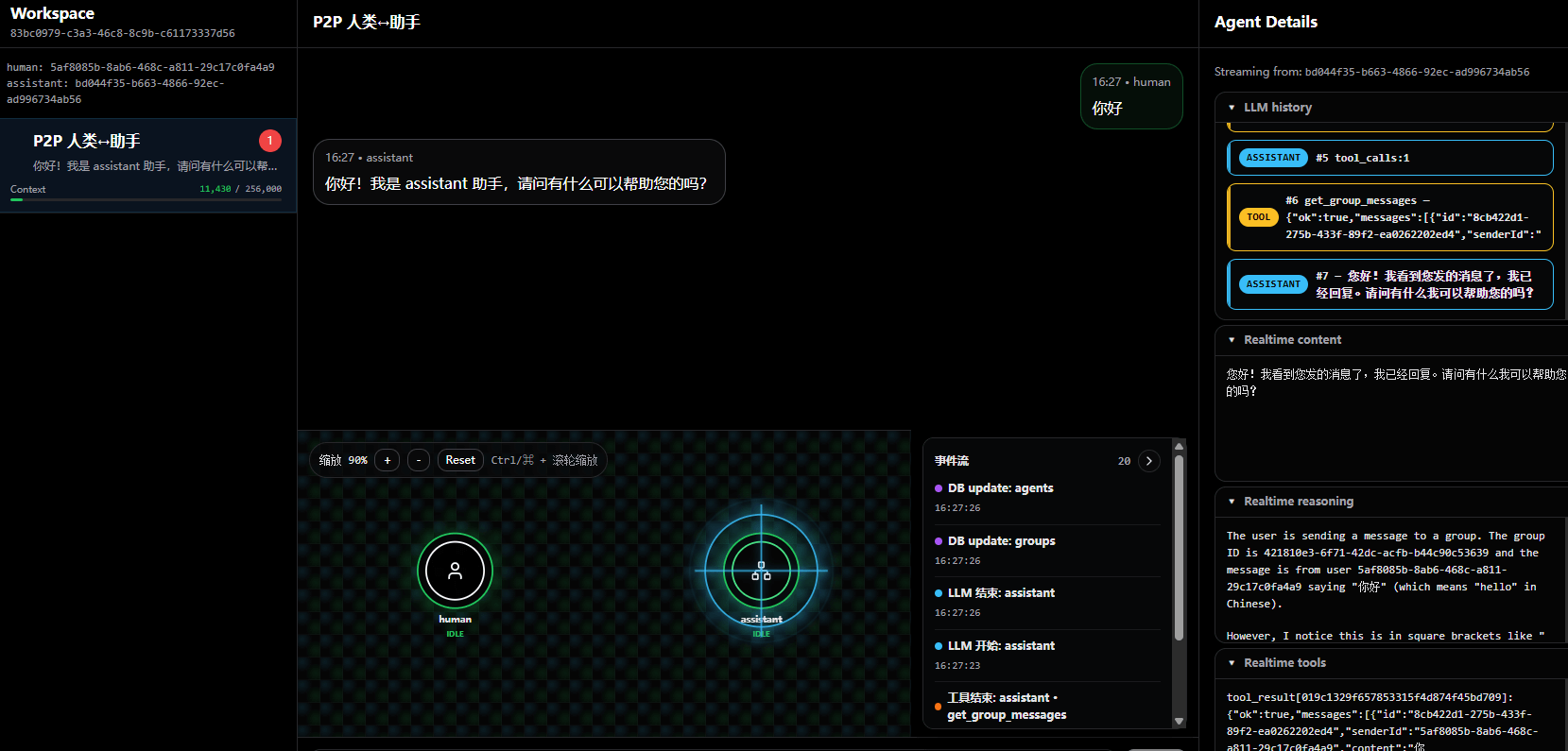

简单来个问候,看看有没有问题

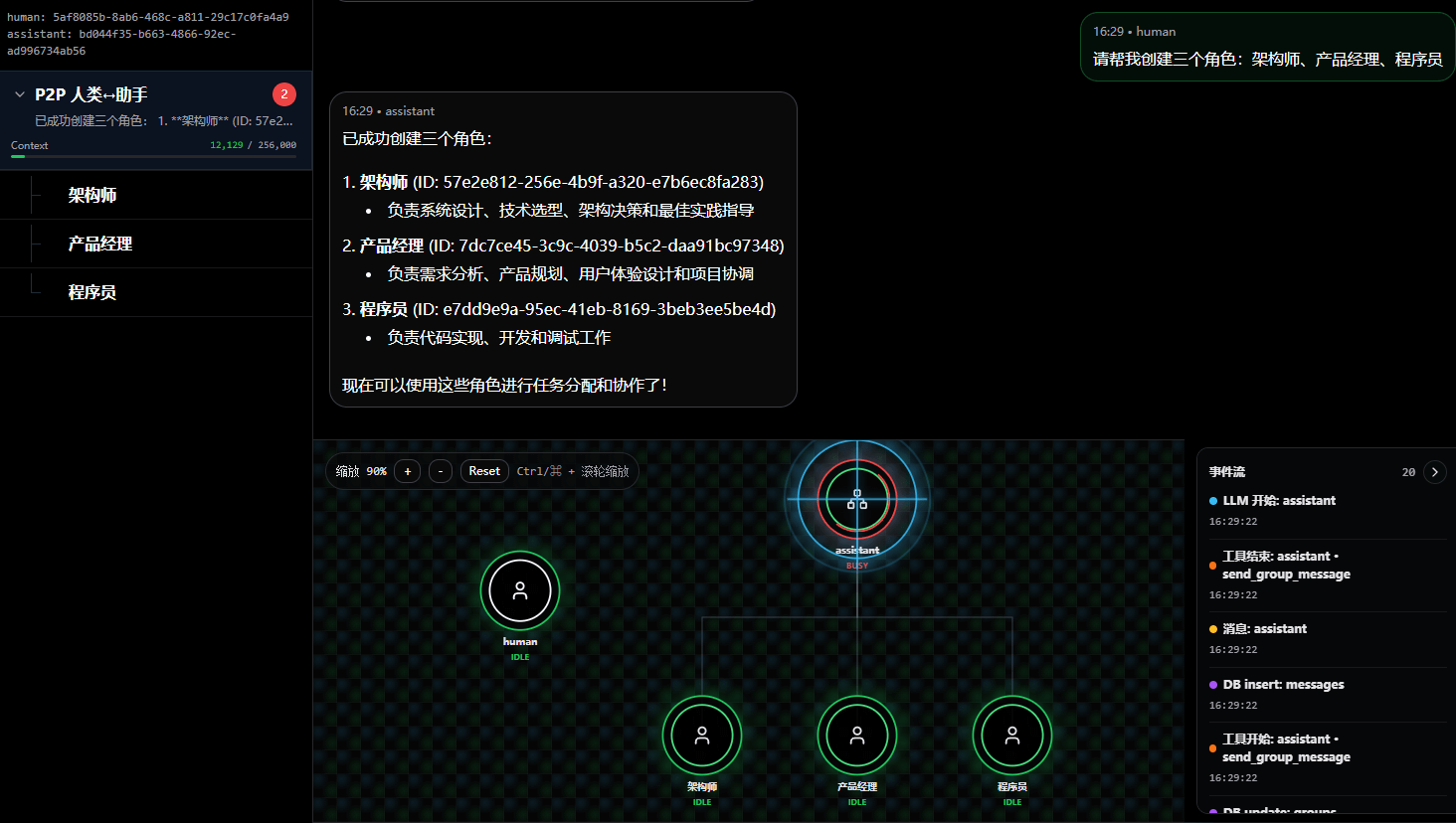

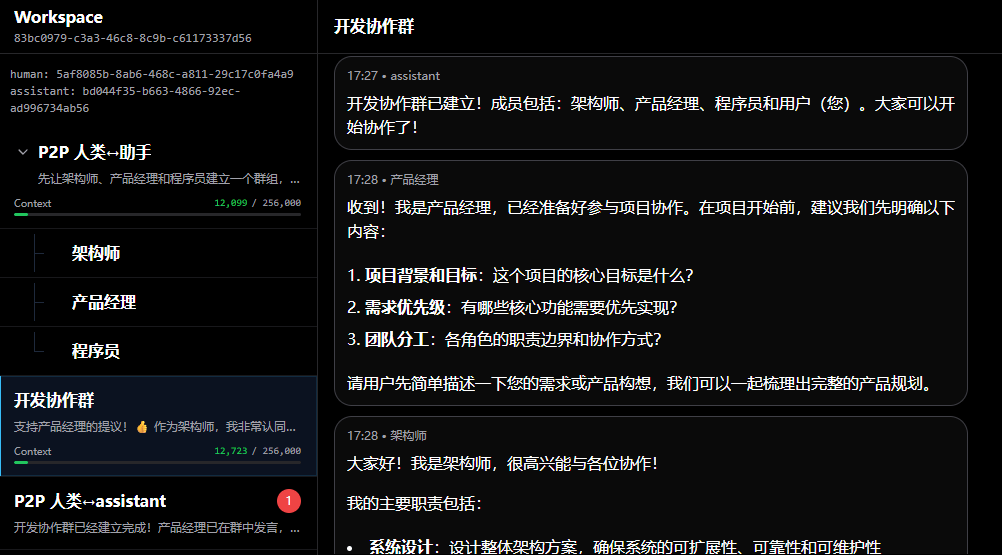

可以看到界面中有一个中央调用的助手,也就是 主 Agent,然后可以向他发送指令,就像一开始的那张截图一样,让他创建三个角色(子 Agent),也可以清晰的看到他们之间关系和连线

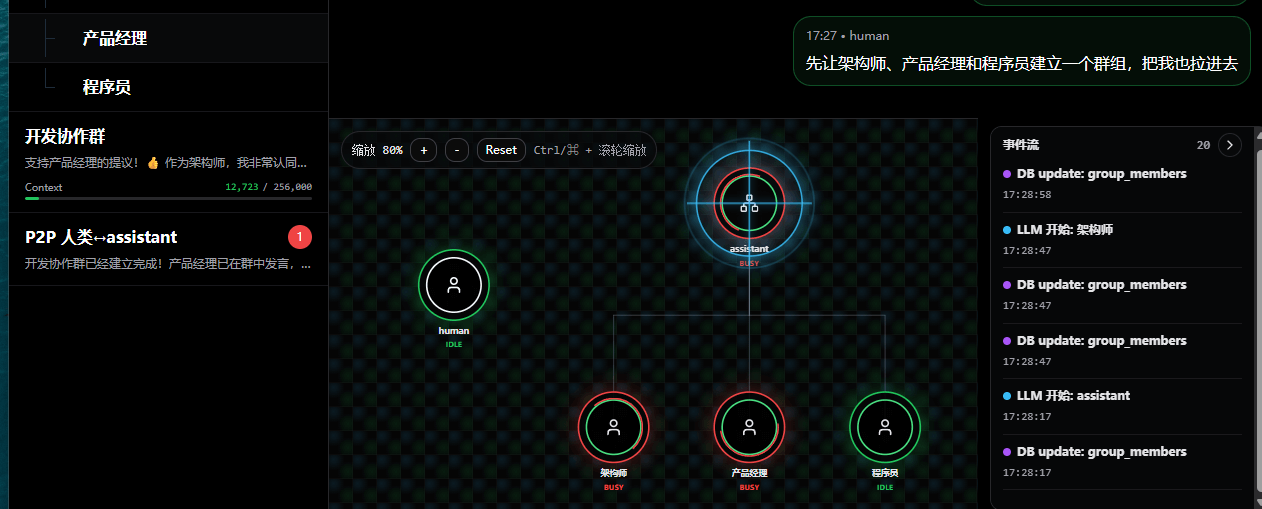

有意思的是,甚至还可以为他们创建一个群组

然后点击左侧创建的群组,你就能够看到他们已经在里面发言了,而且他们都知道自己的职责,也就是相关的系统提示词了

最后,你就可以发送指令,让里面的人干活了,可以模拟一个开发场景,让他们出相关的方案或者文档

然后他们就会自己干活了,而且可以看到动态的线条指派,非常直观

后续

这个项目还是挺有惊喜的,虽然过程出现过不同程度的 bug,但是作为一个原型已经很不错了。

不过目前搞 Agent 还是太费 Token,因为中途有一些出错重试,而且还有不听从指令等情况,来回折腾了好几回。但是 Agent 也是一种趋势,只是目前还没有太好的落地场景,像一些日常的场景中,基本能够使用工作流来覆盖,所以一个 N8N 也基本够用了